從工具到夥伴:新聞媒體的人機協作藍圖

陳洧農|特約記者採訪報導

如果你不是可被信任的資訊驗證者,其實AI是不會引用你的東西的。

~王維菁

「2026台北雜誌年會暨第十屆第三次會員大會」的第二場主題演講,是由師大大傳所教授王維菁主講的「AI導入新聞產製:人機協作、效能升級與倫理風險治理」。王維菁一方面從國際視野切入,借鏡有關新聞的AI倫理及政策規範,一方面從分享國內媒體產業現場的AI應用觀察,並進一步為未來的媒體內部治理、風險管控以及人才培育提供策略方向。

重新塑形的資訊流

王維菁表示,生成式AI的興起,已經使閱聽習慣產生變化:AI逐漸取代許多平台,成為資訊入口。根據英國牛津路透新聞學研究所的報告《Generative AI and News Report 2025》,2024年到2025年間,使用AI的民眾比例從40%提升到61%。

值得注意的是,民眾使用AI的主要用途是資訊查詢(24%),超過內容生成(21%)。「用AI看新聞」雖然僅佔了6%,但王維菁指出,在資訊查找的過程中,許多AI引用的資料也是來自新聞,6%有低估之嫌。

民眾越來越常在AI介面完成理解,而不點進新聞頁。美國皮尤研究中心(Pew Research Center)以2025年3月的Google搜尋資料進行分析,發現當出現AI摘要時,使用者點擊搜尋結果的比例佔8%,未出現AI摘要時則提升至15%。未來內容產業的KPI可能從「搜尋引擎最佳化」(SEO)轉向「被引用率」(citation share),看重引用所帶來的品牌直訪或訂閱轉換。

除了稀釋點擊率,AI摘要帶來的另一個危機是:AI往往會放大國際主流媒體的影響力,使得地方新聞,或是比較非主流國家的新聞更為邊緣化。雪梨大學研究Co-pilot的434則新聞回應,發現大約只有20%的回應會連結到澳洲媒體,且多集中於大型媒體;獨立/地方媒體或個別記者幾乎都是缺席的。

王維菁說,這帶來一個警示:如果AI的摘要缺乏社會敏感度,會讓國際大媒體更主導資訊流,進一步侵蝕地方媒體的流量跟收入。這個現象可能推動各國重新思考「平台/AI業者」與新聞媒體的議價機制。

王維菁表示,對新聞媒體而言,「被AI引用」的重要性日漸增加。(特約記者陳洧農攝)

AI如何改變新聞產製

王維菁表示,當新聞業導入AI,提高效能只是第一步,更重要的是它會改變新聞生產的流程。目前可以觀察到,在新聞生產中出現了「前段自動化,後段責任化」的新結構。

新聞產製中,常見的AI用途包括語音轉錄、外電編譯自動化、協助預測及決策輔助等。AI進入新聞室的典型路徑,是在人類記者採訪素材、蒐集原始資料後,交由AI處理轉錄、生成摘要甚至初稿。接下來由人類記者進行查核、補充脈絡以及在地化調整,最後經編輯台審核發佈。她說,AI在「資訊整理」的階段效益最高,可是接近「價值判斷」或「公共責任」的環節時,就非常需要嚴格的人為治理。

王維菁表示,在整個流程中,核心的問題不在於AI的產能好不好,而是媒體應該自問:哪些環節可以用AI自動化?哪些環節絕對不可以?又有哪些環節一定要有人來把關?

不同的協作型態

台灣媒體產業的AI導入,有不同的型態:一些大型媒體積極建置AI系統或AI專案小組。有些網路媒體則採取「沙盒實驗」的方式,把AI串接進後台,讓記者可以在比較封閉與安全的範圍裡做探索跟實驗。另外有一些媒體採取「系統化編譯」,建立系統抓取全球資料,並生成初稿,對資訊整合跟生產效能特別有效率。

整體來看,人跟AI已經慢慢在新聞業裡形成一種穩定的工作模式。這個模式表面看起來是效率配置,實際上是責任的重新分配:越是自動化的流程,越應該建立「留痕與回溯」的機制,才能在發生問題時回溯出錯的環節。

王維菁表示,生成式AI的出現挑戰了新聞真實性的邊界。真實是新聞以及媒體公信力最重要的底線,因此媒體需要建立嚴格的紅線,避免新聞的真實性受到侵蝕。「它不是追求效率的問題,而是捍衛社會信任的過程。」

民眾對AI新聞的接受度

根據英國牛津路透新聞學研究所2025年的調查,只有大約12%的民眾可以接受完全由AI製作的新聞;若是「AI製作,經人類審查」(Human-in-the-loop),比例則提升至21%;而「由人類主導,AI協助」的接受度來到43%。不過有趣的是,「完全由人類產製」的新聞,民眾接受度還是只有62%。

目前對閱聽眾來說,對於AI在後台的應用普遍較能接受,例如修改錯字、文法,以及翻譯,接受度均超過50%。對於前台用途則較排斥,例如「生成擬真照片」,接受度只有26%;「AI新聞主播」更低,只有19%。

一個嚴重的問題是,只有33%的民眾相信新聞機構使用AI時,會負責任地檢查AI輸出,顯見民眾對新聞媒體的信任度依然低落。換言之,「透明揭露」跟「人工把關」,是未來新聞媒體挽回民眾信任的基礎。

聽到「完全由人類產製」的新聞,民眾接受度還是只有62%,現場聽眾不禁莞爾。(特約記者陳洧農攝)

AI新聞倫理原則

王維菁表示,AI新聞的核心倫理原則,第一也是最重要的,就是「人工最終審查」。換言之,絕對不能讓AI獨立發布新聞,新聞發布的最後一關必須要由人類的編輯負責。這是因為新聞涉及了事實的呈現以及價值的選擇,「我們不可能由人工智慧或機器來幫我們塑造真實,以及做價值的選擇。所以這必須要由可以被問責主體來承擔。」

第二個原則是透明揭露,閱聽人有權知道他看到的內容裡,AI介入程度有多少,所以必須區分「AI輔助整理」還是「純AI生成」,並建立相對應的揭露文字跟標準。

最後則是責任歸屬。在使用AI輔助生成之後,一旦出錯,法律和道德責任還是在媒體身上,不能以「工具出錯」為由卸責。因此,在AI對新聞影響日益重大的今天,建立更完善的內部審核機制更顯重要。

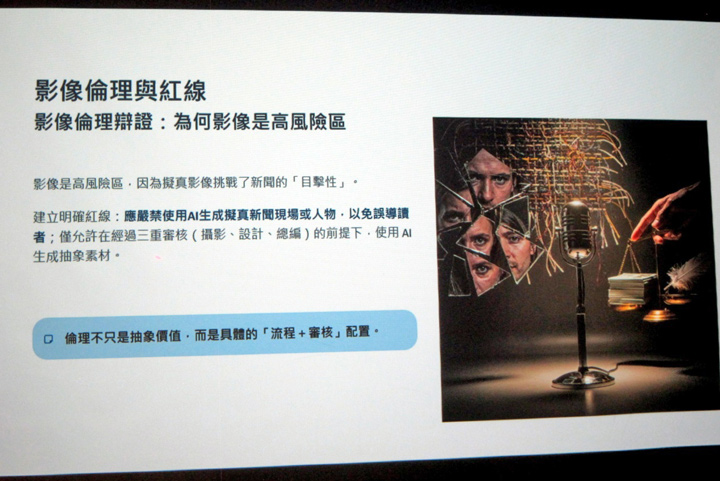

王維菁表示,AI的新聞倫理當中,與影像有關的部分格外重要,因為影像是AI的高風險區,擬真影像挑戰了新聞現場的「目擊性」。所以,AI生成影像可以用在非事實性的新聞上,例如示意圖;若是有現場發生的新聞實景,不應使用AI模擬。她強調,使用AI生成影像應經過三重審核,包括攝影、設計、還有編輯的把關。

王維菁指出,影像是新聞AI應用的高風險區。(特約記者陳洧農攝)

國際AI政策趨勢

王維菁表示,近年來主要民主國家的人工智慧政策,已從最初的「促進創新與產業競爭力」,轉向為以公共利益跟社會風險為核心的治理。這樣的轉向並不是反對AI,反而是承認AI已深度影響資訊的可信度、公共討論以及民主溝通的品質。

在此脈絡下,新聞媒體不只是AI的「應用場域」,而是高影響力的公共資訊中介者,所以各國政策都會注重AI介入新聞產製時,應避免誤導閱聽人、確保責任歸屬,以及揭露、留痕等問責制度的設計。這種態度上的改變,代表新聞AI的問題,不再只是媒體技術的升級問題,而是關乎民主治理。

以最重視風險分級的歐盟為例,其於2024年訂定的《人工智慧法案》(EU AI Act),對AI治理的核心,是將「避免誤導」、「可追究責任」制度化,納入透明化義務與責任流程中。例如:跟聊天機器人互動時,讓人知道對方是機器;生成式AI的提供者必須確保生成內容可以被辨識;深偽(Deepfake)以及「用於告知大眾公共利益事項的文本」必須清楚標示。這些透明規則將於2026年8月開始正式生效。

對新聞媒體而言,這些原則可整理為三個具體要求:第一是辨識,媒體必須要能清楚辨識哪些內容、聲音、圖片係由AI生成或介入;第二是揭露,使用AI生成內容時,原則上必須對外揭露,避免誤導;最後是留痕與追溯,以便在爭議發生時能釐清責任鏈。這些要求能讓AI新聞倫理具備可檢核性,而不只是抽象的自律聲明。

治理實務建議 自問:能否承擔風險

王維菁建議,應對新聞的AI使用做風險分類,例如逐字稿、外電、翻譯、資料彙整這類可被人工驗證者,屬於低風險應用。而像是生成標題、文案、圖片,則屬於中度風險,需要人工覆核與標示。高度風險的應用包括模擬新聞現場、合成主播或涉及人身名譽的內容,原則上不應使用。她認為,這樣的做法呼應歐盟的風險分級邏輯與日本的事前指引模式,重點不在於「能不能用AI」,而在於「能否承擔這個用途的後果」。

她進一步說明,多數國際治理案例都指出,AI出問題時,真正的問題不在「用了AI」,而是「說不清楚怎麼用」。因此新聞業者需要建立最小可行的留痕與稽核機制,例如使用的模型類型、服務來源、AI介入的工作環節、人工審閱的節點等。至於透明與揭露,王維菁建議應予標準化,使用固定的語句或標示,甚至放在固定的位置,讓民眾有可預期的一致性。

王維菁笑說:「我有點好奇:以後學生的論文如果用AI要不要標示或揭露?學生可能會覺得頭很痛。」(特約記者陳洧農攝)

授權談判策略:把內容當資產

王維菁表示,媒體應將內容當作資產來治理,因為在AI的生態系當中,新聞媒體其實同時扮演兩種角色:一方面是AI的使用者,另一方面也是訓練資料與內容來源的供給者。若媒體只將 AI 當工具,而忽略了自身資產的價值,可能會逐步失去自主性跟選擇權。所以,跟 AI 平台業者合作談判時,策略考量應該涵蓋:是否准許內容用於模型訓練、有無回饋或補償機制,以及是否保留退出跟調整條款等。

在AI的資訊生態中,內容資產有三種變現路徑,一種是提供內容給模型訓練的授權,例如金融時報與OpenAI簽署內容授權的合作協定,讓ChatGPT可引用其新聞,並提供授權內容。另外一種是讓AI回覆中的引用內容可以導流回新聞網站。第三種模式,則是內容業者跟AI平台以投資或技術合作的方式擴張地方新聞。

也就是說,媒體與AI業者的談判策略不只是關乎「給不給資料」,也應該將使用場景、署名、連結、分潤制度、退出條款以及新聞媒體是否擁有最後的稽核權等事項納入考量。

最後,王維菁表示,在生成式內容的快速擴散下,媒體的角色應該從「最快的發布者」轉為「被信任的資訊驗證者」,競爭的重點不再是速度,而是可檢視、追溯與究責的態度。「如果你不是可被信任的資訊驗證者,其實AI是不會引用你的東西的。可以說未來媒體的核心競爭力,將取決於我們在使用AI後,是不是可以得到社會大眾的信任,甚至AI平台的信任。」

記者手記:當「影像真實」被挑戰,意外完成的媒體素養教育

筆者觀察到,在討論 AI 介入新聞產製的倫理風險時,國內新聞界最激烈的衝突點莫過於「擬真影像」的使用。之前「上下游新聞市集」引發的爭議,核心便在於攝影記者群體對於「見證者」權威的保衛。

然而,新聞業向來接受黑白照片對色彩的抽離,或是廣角鏡頭對空間的扭曲,這些手段在本質上皆不符「光學真實」,卻被納入專業敘事的合法範疇。攝影記者群體在抨擊 AI 擬真影像時,常以「infographic(資訊圖表)一眼即可辨識為假」作為倫理防線;然而,這種辨識能力往往並非絕對,而是建立在一定的先備知識與文化資本上。若媒體已做到明確標示,卻仍因「太像照片」而被排斥,顯示出新聞業對真實的捍衛,已從「資訊的傳達」轉向對「生產過程合法性」的解釋權。

另一項被常用來反對AI擬真影像的理由是,從認知心理學的角度,「大腦會將自動將擬真影像標記為真實」。但是,這同樣不是絕對的。筆者長期追蹤不實訊息防治議題,過去數年政府與學界大力倡導媒體素養,告訴民眾「圖片可以被裁切、文字可以被誤導」,不要第一眼看到圖像就隨之起情緒反應,但進展始終有限。諷刺的是,自人工智慧 圖像普及後,網路上出現新奇影像時,底下開始大量出現「這是 AI 嗎?」的自發提問。最終,讓民眾學會「慢下來、先懷疑」的,並非精緻的教材,而是AI帶來的視覺震撼教育。