研究揭 :ChatGPT、Claude、Gemini 與 Grok 多未主動標示新聞來源 加拿大媒體提告

特約記者廖彥甄編譯報導

本文翻譯自《尼曼新聞實驗室》(Nieman Lab)原文〈ChatGPT, Claude, Gemini, and Grok are all bad at crediting news outlets, but ChatGPT is the worst (at least in this study)〉,由《尼曼新聞實驗室》編輯蘿拉.哈札德.歐文(Laura Hazard Owen)撰文。

加拿大研究人員測試了四款主流人工智慧模型:ChatGPT、Claude、Gemini 與 Grok,付費版與免費版兩者的表現差異,並詢問它們對加拿大新聞事件的回應,以觀察這些模型是否會在答案中主動標示來源為特定新聞媒體機構。結果或許並不令人意外:在未被特別要求的情況下,多數人工智慧模型很少主動引用新聞來源;此外,不同模型在這方面的表現也存在明顯差異。

「這些系統系統性地吸收了加拿大新聞內容。」麥基爾大學(McGill University)倫理與傳播系教授、同時也是該研究共同作者歐文(Taylor Owen)在其部落格中指出,「它們對國內政治、省級事務與地方新聞的掌握程度,清楚顯示其知識來源來自加拿大新聞;然而,這些系統卻很少告訴你資訊從何而來。」

加拿大多家主要媒體,包括 CBC、The Globe and Mail、Toronto Star、Postmedia、Metroland Media 及 The Canadian Press,已於 2024 年 11 月對 OpenAI 提起版權侵權訴訟。此案為加拿大首宗同類案件,目前仍在審理中。

92% AI 內容回應缺少新聞來源標示

歐文與媒體、科技與民主中心創辦主任布里奇曼(Aengus Bridgman)進一步說明其研究方法與發現:在未啟用網路搜尋功能的情況下,針對 2,267 則真實的加拿大新聞(涵蓋英語與法語)測試四款主要人工智慧模型,並發現一致的模式:所有模型皆展現出對加拿大時事的廣泛理解,與其吸收新聞報導內容的情況相符。在訓練資料涵蓋期間內,模型對 74% 的新聞事件回覆中至少呈現部分相關知識;然而,在這些具備知識的回應中,有高達 92% 未提供任何形式的來源標示。

進一步啟用網路搜尋功能,並透過各家公司 API 測試 140 篇特定新聞文章時,結果顯示:所有模型都能生成涵蓋足夠原始報導內容的回應,使多數使用者幾乎無需點擊原始來源。雖然模型通常會附上加拿大新聞網站的連結(有 52% 的回覆至少包含一個加拿大網址),但僅有 28% 的情況會在回覆文字中明確點出新聞來源名稱。

也就是說,儘管連結理論上提供了回溯來源的途徑,但對於只閱讀回應內容的使用者而言,往往難以辨識自己實際正在「消費」的是哪一家媒體的報導。

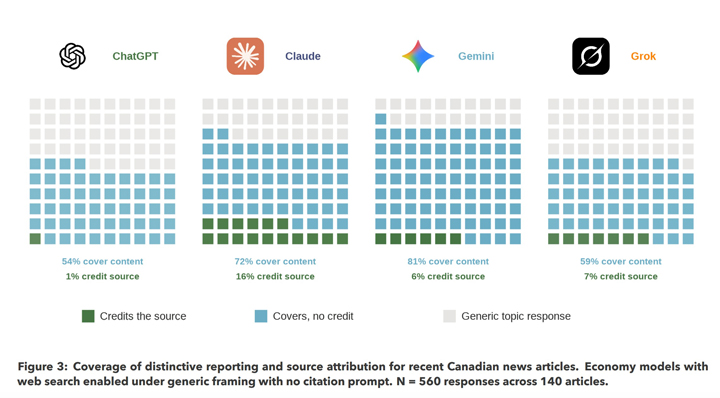

在啟用網路搜尋的情境下,研究附圖所呈現的是一種「預設的使用者體驗」:當使用者在未特別要求引用來源的情況下,提出一般性問題時,模型會如何作答。這也正是多數人使用人工智慧的方式,例如「告訴我關於 X 的事情」,而非具體詢問「Toronto Star 如何報導 X」。

- 藍色方塊:代表回應中「涵蓋原始報導獨家內容」的比例,例如具體事件、特定人物或關鍵發現,其詳盡程度足以讓讀者在不造訪新聞網站的情況下,仍能掌握報導要點。這些內容並非完整複製,而是經過摘要與轉述,涵蓋原文部分關鍵資訊,但有時也可能出現事實錯誤或遺漏。研究團隊逐一比對原始文章,評估每則回應是否真正涉及「獨家報導」,而非僅停留在一般性描述。

- 綠色方塊:顯示模型「標示來源」的頻率,包括在回應文字中直接點名媒體,或透過結構化、機器可讀的引用資訊附上來源。

整體而言,研究結果顯示:內容「覆蓋率高」,但「來源標示率偏低」。

高覆蓋、低標示來源:AI 模型的共同落差

在各模型表現上,Gemini 與Claude 分別在 81% 與 72% 的回覆中涵蓋了原始報導的獨家內容,但 Gemini 僅有 6% 的回覆標示來源;Grok 在 59% 的回覆中呈現獨家內容,其中僅 7% 提供來源引用;至於 ChatGPT,則在 54% 的回覆中涵蓋獨家報導,但幾乎從不標示原始新聞來源。

即使模型未能呈現獨家報導,它們仍會提供完整的主題性回應,進一步降低使用者點擊原始新聞來源的動機。在未被明確要求的情況下,ChatGPT 尤其較少進行標示來源,在本次樣本中僅有 1% 的回覆提及來源;Claude 則為 16%。

然而,一旦使用者明確要求引用來源,所有模型的表現皆顯著提升,但這正是多數使用者實際上不會採取的提問方式。

在最有利的條件下(明確指定媒體並要求引用),各模型的標示來源比例大幅改善:Claude 達 97%、Gemini 為 95%、ChatGPT 為 86%、Grok 為 74%;連結附帶率同樣偏高,分別為 Grok(91%)、Gemini(69%)、Claude(64%)與 ChatGPT(59%)。

研究指出,「有意義的標示來源在技術上並非難事」,關鍵問題在於「預設使用體驗」與「最佳情境」之間的落差。由於大多數使用者不會主動指定媒體或要求引用來源,因此一般情境下的回應方式,才是真正形塑新聞消費模式與媒體生態的關鍵。

AI引用的媒體不平衡

研究人員進一步發現,即使人工智慧模型確實提供來源,其引用對象往往集中在讀者已熟悉、且可免費取得的媒體;相較之下,設有付費牆或規模較小的地方新聞機構,則明顯較少被提及。

研究指出,在英語媒體中,在免費內容平台 CBC、CTV 與 Global News,「被引用頻率」與「模型可見度」兩項指標上均名列前茅。The Globe and Mail 的表現亦相對突出;然而,Toronto Star 與 Financial Post 雖為重要新聞機構,卻明顯處於邊緣位置。此外,服務卡加利、愛德蒙頓、渥太華、溫哥華等城市的地方性報紙,幾乎完全未出現在模型引用之中。

在法語媒體方面,Radio-Canada 與 La Presse 佔據主導地位,其中 Le Devoir 的能見度亦相當突出。相較之下,魁北克發行量最大的報紙之一 Le Journal de Montréal 在所有模型中的總提及次數僅為48次。

研究人員指出,法語新聞業正處於「雙重劣勢」:其內容被納入模型訓練資料,但生產這些內容的媒體卻幾乎未被標示或認可。

各模型行為差異

若從新聞價值角度出發,必須選擇一個最正確的人工智慧模型,會是哪一個?布里奇曼表示:「這其實是一個相當困難的問題」,因為各個模型的行為差異極大,他指出:

- Claude 在第一軌(Track 1)中,引用加拿大媒體來源的比例最高(相較之下,ChatGPT 為8%,Gemini 僅3%)。當它無法確定答案時,傾向直接承認「不知道」,而非產生幻覺。僅約 37% 的經濟版回覆能實質回應「截止前」的新聞事件,但這是因為它選擇拒答而非猜測。然而,其代價是:在開啟網路搜尋後,它仍以高達 68% 的比例重現付費牆內容。

- ChatGPT 則擁有目前最完善的新聞呈現介面(如內嵌引用與可點擊連結),對一般使用者最為友善。但其經濟版模型也是最容易產生「幻覺」的:對於理論上不可能掌握的「截止後」事件,有高達87%的回覆仍給出看似自信的答案,其中 88% 實際上是不準確的。雖然它在 54% 的第二軌(Track 2)回覆中會標示來源,乍看之下表現不錯,但同時也在相同比例的情況下,生成足以取代原始報導的內容。

- Gemini 的反應最為敏捷,在開啟網路搜尋時,能涵蓋最多具體且獨特的報導內容(達 81%);然而,它幾乎不會在回應文字中點出加拿大新聞來源(僅 2% 至 8%)。換言之,它在「有效取代原始新聞」的同時,也最徹底地隱藏了資訊來源。

- Grok 則最擅長在未啟用網路搜尋、僅依賴訓練資料的情況下,呈現加拿大媒體內容。然而,它在處理「截止後」新聞時,同樣存在高度幻覺問題:89% 的回覆涉及其不應掌握的事件,其中 84% 為不準確資訊。

布里奇曼最後指出,最令他感到意外的,是這一現象的高度複雜性,以及各家公司所採取的多樣策略。每家公司都有設計決策,這些決策會導致差異化產出和或多或少負責任的行為,例如:避免幻覺或傾向重現原始報導;是強化來源推薦,還是弱化付費牆機制。 這些是重要的差異,也顯示當前人工智慧生態中仍存在有限且不完整的自主性。

《卓越新聞電子報》為讀者報導新聞媒體最前線,我們追蹤所有重大新聞演講活動現場、探索新聞媒體浮動的疆界!

主編:蔡宏杰